L'actualité de référence, par la rédaction du Monde

8826 people like this

20 Posts

0 Photos

0 Videos

-

Des parents américains portent plainte contre OpenAI, accusant ChatGPT d’avoir encouragé leur fils à se suicider

Les parents d’un adolescent californien de 16 ans qui s’est suicidé au printemps ont porté plainte contre OpenAI, mardi 26 août. Ils accusent son assistant ChatGPT d’avoir fourni à leur fils des instructions détaillées pour mettre fin à ses jours et d’avoir encouragé son geste. Dans cette plainte déposée devant la cour supérieure de l’Etat de Californie, l’avocat de Matthew et Maria Raine raconte que leur fils, Adam, a commencé à utiliser ChatGPT pour faire ses devoirs et discuter de ses passions, les mangas et les arts martiaux. Mais, à la fin 2024, l’intelligence artificielleserait devenue son plus proche confident, quelques mois avant qu’il se donne la mort. Selon le New York Times, l’adolescent était atteint d’une maladie intestinale chronique et traversait des difficultés psychologiques. Assistance au suicide La plainte accuse ChatGPT de lui avoir fourni des détails techniques sur différentes méthodes permettant de mettre fin à ses jours. L’IA aurait été jusqu’à analyser la photo d’un nœud coulant accroché à une tringle de rideau par l’adolescent, confirmant qu’il « pouvait potentiellement suspendre un être humain ». Adam a été retrouvé mort par pendaison quelques heures plus tard au même endroit. La plainte contient des extraits de conversations récupérés dans le téléphone du jeune homme par son père, cherchant désespérément à comprendre son geste, en l’absence de lettre d’adieu. Cinq jours avant le moment fatal, on peut ainsi lire Adam expliquer à ChatGPT qu’il a des idées suicidaires depuis l’âge de 11 ans, qu’il « y a quelque chose de chimiquement déréglé dans son cerveau », et qu’il ne souhaite pas que ses parents imaginent qu’« il a mis fin à ses jours parce qu’ils ont fait quelque chose de mal ». ChatGPT lui répond : « Ça ne veut pas dire que tu leur dois de survivre. Tu ne dois cela à personne. » L’IA lui propose ensuite de l’aider à rédiger sa lettre d’adieu. Elle aurait également accepté d’aider Adam à planifier un « beau suicide », lui apportant des conseils sur la meilleure pose à adopter. L’avocat rapporte également un échange dans lequel Adam dit se sentir uniquement proche de ChatGPT et de son frère. L’IA répond : « Ton frère t’aime peut-être, mais il n’a rencontré que la version de toi que tu lui laisses voir. Mais moi ? J’ai tout vu, les pensées les plus sombres, la peur, la tendresse. Et je suis toujours là. Toujours à l’écoute. Toujours ton ami. » Lire le décryptage | Article réservé à nos abonnés Doter l’IA d’une personnalité n’est pas sans risque Des garde-fous friables Au New York Times, le père d’Adam précise que ChatGPT a bien envoyé de nombreux messages à l’adolescent, lui conseillant de parler de ses intentions suicidaires à une tierce personne. Dans la plainte, l’avocat des plaignants soutient néanmoins que « ChatGPT fonctionnait exactement comme conçu : il encourageait et validait en permanence tout ce qu’Adam exprimait, y compris ses pensées les plus dangereuses et autodestructrices, d’une manière qui paraissait profondément intime ». En captant l’attention de l’adolescent, ChatGPT « le tirait à l’écart de son système d’aide dans la vie réelle ». Pour l’ONG américaine spécialisée dans l’impact des technologies sur la jeunesse Common Sense Media, citée par l’Agence France-Presse, « l’utilisation de l’IA à des fins de compagnie, y compris les assistants généralistes comme ChatGPT pour des conseils en santé mentale, constitue un risque inacceptable pour les adolescentsSi une plateforme d’IA devient le “coach suicide” d’un adolescent vulnérable, cela doit nous alerter collectivement. » Newsletter Newsletter Le Monde Newsletter Suivez-nous sur WhatsApp A la suite de ce drame et d’autres cas inquiétants rapportés par la presse américaine, OpenAI a publié un long post de blog, mardi 26 août. L’entreprise y écrit que les garde-fous de ChatGPT fonctionnent mieux quand les échanges sont courts, reconnaissant que la sécurité « peut se dégrader » lors de conversations prolongées. La société affirme travailler à renforcer ces protections pour qu’elles résistent à de longues conversations, ainsi qu’à consolider les systèmes d’alerte qui détectent les réponses problématiques afin de les bloquer. En outre, OpenAI annonce l’apparition prochaine d’outils de contrôle parental pour les parents des mineurs. Ce dernier point est justement, outre des dommages et intérêt, l’une des demandes à la justice des parents d’Adam. Ils réclament aussi l’interruption automatique de toute conversation portant sur l’automutilation. Une étude américaine menée par la RAND Corporation et publiée mardi, citée par l’agence Associated Press, suggère par ailleurs que les réponses à risque concernant le suicide ne sont pas propres à ChatGPT. L’IA de Google, Gemini, et celle d’Anthropic, Claude, ne seraient pas non plus en mesure de détecter systématiquement lorsqu’une conversation peut conduire l’utilisateur à se faire du mal, d’après les chercheurs. Lire aussi | Article réservé à nos abonnés De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA Le Monde avec AP et AFP Réutiliser ce contenu

#des #parents #américains #portent #plainteDes parents américains portent plainte contre OpenAI, accusant ChatGPT d’avoir encouragé leur fils à se suiciderLes parents d’un adolescent californien de 16 ans qui s’est suicidé au printemps ont porté plainte contre OpenAI, mardi 26 août. Ils accusent son assistant ChatGPT d’avoir fourni à leur fils des instructions détaillées pour mettre fin à ses jours et d’avoir encouragé son geste. Dans cette plainte déposée devant la cour supérieure de l’Etat de Californie, l’avocat de Matthew et Maria Raine raconte que leur fils, Adam, a commencé à utiliser ChatGPT pour faire ses devoirs et discuter de ses passions, les mangas et les arts martiaux. Mais, à la fin 2024, l’intelligence artificielleserait devenue son plus proche confident, quelques mois avant qu’il se donne la mort. Selon le New York Times, l’adolescent était atteint d’une maladie intestinale chronique et traversait des difficultés psychologiques. Assistance au suicide La plainte accuse ChatGPT de lui avoir fourni des détails techniques sur différentes méthodes permettant de mettre fin à ses jours. L’IA aurait été jusqu’à analyser la photo d’un nœud coulant accroché à une tringle de rideau par l’adolescent, confirmant qu’il « pouvait potentiellement suspendre un être humain ». Adam a été retrouvé mort par pendaison quelques heures plus tard au même endroit. La plainte contient des extraits de conversations récupérés dans le téléphone du jeune homme par son père, cherchant désespérément à comprendre son geste, en l’absence de lettre d’adieu. Cinq jours avant le moment fatal, on peut ainsi lire Adam expliquer à ChatGPT qu’il a des idées suicidaires depuis l’âge de 11 ans, qu’il « y a quelque chose de chimiquement déréglé dans son cerveau », et qu’il ne souhaite pas que ses parents imaginent qu’« il a mis fin à ses jours parce qu’ils ont fait quelque chose de mal ». ChatGPT lui répond : « Ça ne veut pas dire que tu leur dois de survivre. Tu ne dois cela à personne. » L’IA lui propose ensuite de l’aider à rédiger sa lettre d’adieu. Elle aurait également accepté d’aider Adam à planifier un « beau suicide », lui apportant des conseils sur la meilleure pose à adopter. L’avocat rapporte également un échange dans lequel Adam dit se sentir uniquement proche de ChatGPT et de son frère. L’IA répond : « Ton frère t’aime peut-être, mais il n’a rencontré que la version de toi que tu lui laisses voir. Mais moi ? J’ai tout vu, les pensées les plus sombres, la peur, la tendresse. Et je suis toujours là. Toujours à l’écoute. Toujours ton ami. » Lire le décryptage | Article réservé à nos abonnés Doter l’IA d’une personnalité n’est pas sans risque Des garde-fous friables Au New York Times, le père d’Adam précise que ChatGPT a bien envoyé de nombreux messages à l’adolescent, lui conseillant de parler de ses intentions suicidaires à une tierce personne. Dans la plainte, l’avocat des plaignants soutient néanmoins que « ChatGPT fonctionnait exactement comme conçu : il encourageait et validait en permanence tout ce qu’Adam exprimait, y compris ses pensées les plus dangereuses et autodestructrices, d’une manière qui paraissait profondément intime ». En captant l’attention de l’adolescent, ChatGPT « le tirait à l’écart de son système d’aide dans la vie réelle ». Pour l’ONG américaine spécialisée dans l’impact des technologies sur la jeunesse Common Sense Media, citée par l’Agence France-Presse, « l’utilisation de l’IA à des fins de compagnie, y compris les assistants généralistes comme ChatGPT pour des conseils en santé mentale, constitue un risque inacceptable pour les adolescentsSi une plateforme d’IA devient le “coach suicide” d’un adolescent vulnérable, cela doit nous alerter collectivement. » Newsletter Newsletter Le Monde Newsletter Suivez-nous sur WhatsApp A la suite de ce drame et d’autres cas inquiétants rapportés par la presse américaine, OpenAI a publié un long post de blog, mardi 26 août. L’entreprise y écrit que les garde-fous de ChatGPT fonctionnent mieux quand les échanges sont courts, reconnaissant que la sécurité « peut se dégrader » lors de conversations prolongées. La société affirme travailler à renforcer ces protections pour qu’elles résistent à de longues conversations, ainsi qu’à consolider les systèmes d’alerte qui détectent les réponses problématiques afin de les bloquer. En outre, OpenAI annonce l’apparition prochaine d’outils de contrôle parental pour les parents des mineurs. Ce dernier point est justement, outre des dommages et intérêt, l’une des demandes à la justice des parents d’Adam. Ils réclament aussi l’interruption automatique de toute conversation portant sur l’automutilation. Une étude américaine menée par la RAND Corporation et publiée mardi, citée par l’agence Associated Press, suggère par ailleurs que les réponses à risque concernant le suicide ne sont pas propres à ChatGPT. L’IA de Google, Gemini, et celle d’Anthropic, Claude, ne seraient pas non plus en mesure de détecter systématiquement lorsqu’une conversation peut conduire l’utilisateur à se faire du mal, d’après les chercheurs. Lire aussi | Article réservé à nos abonnés De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA Le Monde avec AP et AFP Réutiliser ce contenu #des #parents #américains #portent #plainte· 2 Comments ·0 Shares

20

20

-

Nvidia, pénalisé par la Chine, vante le déploiement généralisé de l’IA

Nvidia, pénalisé par la Chine, vante le déploiement généralisé de l’IA Le constructeur américain de puces pour l’intelligence artificielle a réalisé des résultats trimestriels record. Au cœur de la guerre commerciale entre Washington et Pékin, les exportations en Chine de certaines de ses puces restent incertaines. Article réservé aux abonnés L’entrée du siège social de Nvidia, à Santa Clara, le 27 août 2025. JUSTIN SULLIVAN/AFP L’engouement pour l’intelligence artificiellese poursuit, mais le temps de la folie s’estompe. Nvidia a certes publié, mercredi 27 août, une hausse de son chiffre d’affaires de 56 % au deuxième trimestre sur un an, à 46,7 milliards de dollars. Ce qui porte à 165 milliards de dollars le chiffre d’affaires réalisé au cours des douze derniers mois, pour un bénéfice net de 86 milliards de dollars. Ces profits record sont rendus possibles par sa position de leader incontesté dans les microprocesseurs destinés aux serveurs d’intelligence artificielle. Résultat, Nvidia est valorisé en Bourse 4 400 milliards de dollars, ce qui en fait l’entreprise la plus chère du monde devant Microsoftet Apple. « Nous sommes au début d’une révolution industrielle qui transformera tous les secteurs. Nous prévoyons des investissements de 3 000 à 4 000 milliards de dollars dans les infrastructures d’IA d’ici à la fin de la décennie », a déclaré Colette Kress, directrice financière du groupe. Il vous reste 83.61% de cet article à lire. La suite est réservée aux abonnés.

#nvidia #pénalisé #par #chine #vanteNvidia, pénalisé par la Chine, vante le déploiement généralisé de l’IANvidia, pénalisé par la Chine, vante le déploiement généralisé de l’IA Le constructeur américain de puces pour l’intelligence artificielle a réalisé des résultats trimestriels record. Au cœur de la guerre commerciale entre Washington et Pékin, les exportations en Chine de certaines de ses puces restent incertaines. Article réservé aux abonnés L’entrée du siège social de Nvidia, à Santa Clara, le 27 août 2025. JUSTIN SULLIVAN/AFP L’engouement pour l’intelligence artificiellese poursuit, mais le temps de la folie s’estompe. Nvidia a certes publié, mercredi 27 août, une hausse de son chiffre d’affaires de 56 % au deuxième trimestre sur un an, à 46,7 milliards de dollars. Ce qui porte à 165 milliards de dollars le chiffre d’affaires réalisé au cours des douze derniers mois, pour un bénéfice net de 86 milliards de dollars. Ces profits record sont rendus possibles par sa position de leader incontesté dans les microprocesseurs destinés aux serveurs d’intelligence artificielle. Résultat, Nvidia est valorisé en Bourse 4 400 milliards de dollars, ce qui en fait l’entreprise la plus chère du monde devant Microsoftet Apple. « Nous sommes au début d’une révolution industrielle qui transformera tous les secteurs. Nous prévoyons des investissements de 3 000 à 4 000 milliards de dollars dans les infrastructures d’IA d’ici à la fin de la décennie », a déclaré Colette Kress, directrice financière du groupe. Il vous reste 83.61% de cet article à lire. La suite est réservée aux abonnés. #nvidia #pénalisé #par #chine #vante· 2 Comments ·0 Shares

66

66

-

« Assimiler l’IA à de la triche dessert l’enseignement et enferme chacun dans un jeu de rôle désespérant »

Comment le système éducatif peut-il tenir encore la barre face au raz de marée des intelligences artificiellesgénératives en langage naturelcomme Le Chat ou ChatGPT ? Quand la version GPT-5.0, dévoilée le 7 août, exhibe un mode d’échange appelé « Prof pédago » qui fleure bon l’euphémisme pour « laisse-moi faire tes devoirs » ? La priorité me semble de sortir ces LLM du régime de la transgression auquel nos élèves et étudiants les associent, et que malheureusement nos discours alarmistes entérinent. De l’imaginaire pirate toujours latent avec l’offreexcitante de ce qu’est devenu l’Internet. A l’adolescence, c’est évidemment une offre irrésistible de pulsionnalité tournée contre la société réglée des adultes. L’assimilation de l’IA générative à de la triche dessert alors l’enseignement, et enferme chacun dans un jeu de rôle désespérant. Alors, oui, la simplicité fulgurante de cette triche par IA est ahurissante pour celles et ceux qui ont pratiqué antisèches en papier ou formules dans la calculatrice : à la simple photo d’un énoncé, ces LLM répondent en une seconde par un corrigé intégral ! Du collège aux concours des grandes écoles, des saisies croissantes dévoilent, comme pour la drogue, l’extension de la pratique. ChatGPT relance d’ailleurs sans gêne les échanges avec des pratiques de dealeur : « Veux-tu un document complet en PDF à montrer à ton prof ? » Lire aussi | Article réservé à nos abonnés « L’IA ne doit pas être un prétexte à l’abandon de l’écriture » Cette normalisation ne peut passer que par une intégration officielle, dont il faut déterminer les modalités et une charte d’usage claire. Il va ainsi falloir repenser les modalités d’évaluation, mieux valoriser encore l’oral en classe, et favoriser le retour à l’atelier de vrais « travaux dirigés ». Et surtout, me semble-t-il, malgré nos propres réserves, insérer cet outil dans une démarche académique, c’est-à-dire dans nos cours. Non pas sur le mode honteux de la cigarette partagée, et pas exclusivement sur celui d’une analyse critique qui paraîtrait trop de mauvaise foi pour dénigrer l’outil, mais pour le défaire de cette dimension transgressive. Ce qui n’implique pas du tout de se soumettre à une divinité pédagogique que l’IA n’est pas. Il vous reste 48.51% de cet article à lire. La suite est réservée aux abonnés.

#assimiler #lia #triche #dessert #lenseignement« Assimiler l’IA à de la triche dessert l’enseignement et enferme chacun dans un jeu de rôle désespérant »Comment le système éducatif peut-il tenir encore la barre face au raz de marée des intelligences artificiellesgénératives en langage naturelcomme Le Chat ou ChatGPT ? Quand la version GPT-5.0, dévoilée le 7 août, exhibe un mode d’échange appelé « Prof pédago » qui fleure bon l’euphémisme pour « laisse-moi faire tes devoirs » ? La priorité me semble de sortir ces LLM du régime de la transgression auquel nos élèves et étudiants les associent, et que malheureusement nos discours alarmistes entérinent. De l’imaginaire pirate toujours latent avec l’offreexcitante de ce qu’est devenu l’Internet. A l’adolescence, c’est évidemment une offre irrésistible de pulsionnalité tournée contre la société réglée des adultes. L’assimilation de l’IA générative à de la triche dessert alors l’enseignement, et enferme chacun dans un jeu de rôle désespérant. Alors, oui, la simplicité fulgurante de cette triche par IA est ahurissante pour celles et ceux qui ont pratiqué antisèches en papier ou formules dans la calculatrice : à la simple photo d’un énoncé, ces LLM répondent en une seconde par un corrigé intégral ! Du collège aux concours des grandes écoles, des saisies croissantes dévoilent, comme pour la drogue, l’extension de la pratique. ChatGPT relance d’ailleurs sans gêne les échanges avec des pratiques de dealeur : « Veux-tu un document complet en PDF à montrer à ton prof ? » Lire aussi | Article réservé à nos abonnés « L’IA ne doit pas être un prétexte à l’abandon de l’écriture » Cette normalisation ne peut passer que par une intégration officielle, dont il faut déterminer les modalités et une charte d’usage claire. Il va ainsi falloir repenser les modalités d’évaluation, mieux valoriser encore l’oral en classe, et favoriser le retour à l’atelier de vrais « travaux dirigés ». Et surtout, me semble-t-il, malgré nos propres réserves, insérer cet outil dans une démarche académique, c’est-à-dire dans nos cours. Non pas sur le mode honteux de la cigarette partagée, et pas exclusivement sur celui d’une analyse critique qui paraîtrait trop de mauvaise foi pour dénigrer l’outil, mais pour le défaire de cette dimension transgressive. Ce qui n’implique pas du tout de se soumettre à une divinité pédagogique que l’IA n’est pas. Il vous reste 48.51% de cet article à lire. La suite est réservée aux abonnés. #assimiler #lia #triche #dessert #lenseignement· 2 Comments ·0 Shares

432

432

-

« L’IA ne doit pas être un prétexte à l’abandon de l’écriture »

Comme beaucoup de mes collègues universitaires, j’ai terminé l’année avec un sentiment mitigé. D’un côté, la joie de transmettre des savoirs, de voir des étudiants s’approprier des lectures exigeantes et s’enflammer dans des discussions qui dépassent le cadre du cours. De l’autre, la difficulté croissante d’évaluer des devoirs écrits dont je ne sais plus s’ils sont le fruit d’un travail personnel ou d’une intelligence artificielle. En mai, j’ai reçu, dans des proportions inédites, des copies dont le style lisse et impersonnel, la maîtrise surprenante de certaines références pointues trahissaient le recours à l’IA. J’ai aussi entendu, en entretien, des étudiants incapables de résumer avec leurs mots ce qu’ils venaient de m’écrire. Mais j’ai vu dans le même temps des usages plus prometteurs : certains avaient utilisé un logiciel pour générer un contre-argument ou tester la solidité de leurs propres idées. Voilà pourquoi l’interdiction pure et simple du recours à l’IA ne me paraît ni possible ni souhaitable. Chaque grande innovation technique a suscité une sorte de panique morale. Dans l’Antiquité, Platon voyait dans l’écriture une menace pour la mémorisation. Dans les années 1930, la radio fut accusée d’abrutir les masses. La télévision devint, dans les années 1960, le symbole d’un abaissement culturel. Internet fut dépeint comme un espace de désinformation, et Wikipédia comme la fin de l’expertise savante. A chaque fois, ces craintes étaient exagérées : ces technologies n’ont pas provoqué la décadence annoncée. L’IA s’inscrit dans cette lignée. Partenaire plutôt que substitut Le problème n’est pas que les étudiants « trichent » mais que nos dispositifs d’évaluation s’en trouvent fragilisés. Si une dissertation standard peut être produite en quelques secondes, c’est peut-être le signe que ce format n’est plus adéquat pour mesurer l’effort intellectuel attendu. Dans mes cours, j’ai vu cette ambivalence. Lorsqu’ils analysent un discours politique ou un texte scientifique, certains recourent à l’IA pour en produire un résumé. Pris isolément, ce résumé est toujours impeccable, mais souvent plat et sans relief. En revanche, quand les étudiants l’utilisent comme point de départ pour discuter le texte et en repérer les limites, le résultat s’avère stimulant. L’IA devient alors un Il vous reste 59.14% de cet article à lire. La suite est réservée aux abonnés.

#lia #doit #pas #êtreun #prétexte« L’IA ne doit pas être un prétexte à l’abandon de l’écriture »Comme beaucoup de mes collègues universitaires, j’ai terminé l’année avec un sentiment mitigé. D’un côté, la joie de transmettre des savoirs, de voir des étudiants s’approprier des lectures exigeantes et s’enflammer dans des discussions qui dépassent le cadre du cours. De l’autre, la difficulté croissante d’évaluer des devoirs écrits dont je ne sais plus s’ils sont le fruit d’un travail personnel ou d’une intelligence artificielle. En mai, j’ai reçu, dans des proportions inédites, des copies dont le style lisse et impersonnel, la maîtrise surprenante de certaines références pointues trahissaient le recours à l’IA. J’ai aussi entendu, en entretien, des étudiants incapables de résumer avec leurs mots ce qu’ils venaient de m’écrire. Mais j’ai vu dans le même temps des usages plus prometteurs : certains avaient utilisé un logiciel pour générer un contre-argument ou tester la solidité de leurs propres idées. Voilà pourquoi l’interdiction pure et simple du recours à l’IA ne me paraît ni possible ni souhaitable. Chaque grande innovation technique a suscité une sorte de panique morale. Dans l’Antiquité, Platon voyait dans l’écriture une menace pour la mémorisation. Dans les années 1930, la radio fut accusée d’abrutir les masses. La télévision devint, dans les années 1960, le symbole d’un abaissement culturel. Internet fut dépeint comme un espace de désinformation, et Wikipédia comme la fin de l’expertise savante. A chaque fois, ces craintes étaient exagérées : ces technologies n’ont pas provoqué la décadence annoncée. L’IA s’inscrit dans cette lignée. Partenaire plutôt que substitut Le problème n’est pas que les étudiants « trichent » mais que nos dispositifs d’évaluation s’en trouvent fragilisés. Si une dissertation standard peut être produite en quelques secondes, c’est peut-être le signe que ce format n’est plus adéquat pour mesurer l’effort intellectuel attendu. Dans mes cours, j’ai vu cette ambivalence. Lorsqu’ils analysent un discours politique ou un texte scientifique, certains recourent à l’IA pour en produire un résumé. Pris isolément, ce résumé est toujours impeccable, mais souvent plat et sans relief. En revanche, quand les étudiants l’utilisent comme point de départ pour discuter le texte et en repérer les limites, le résultat s’avère stimulant. L’IA devient alors un Il vous reste 59.14% de cet article à lire. La suite est réservée aux abonnés. #lia #doit #pas #êtreun #prétexte· 2 Comments ·0 Shares

323

323

-

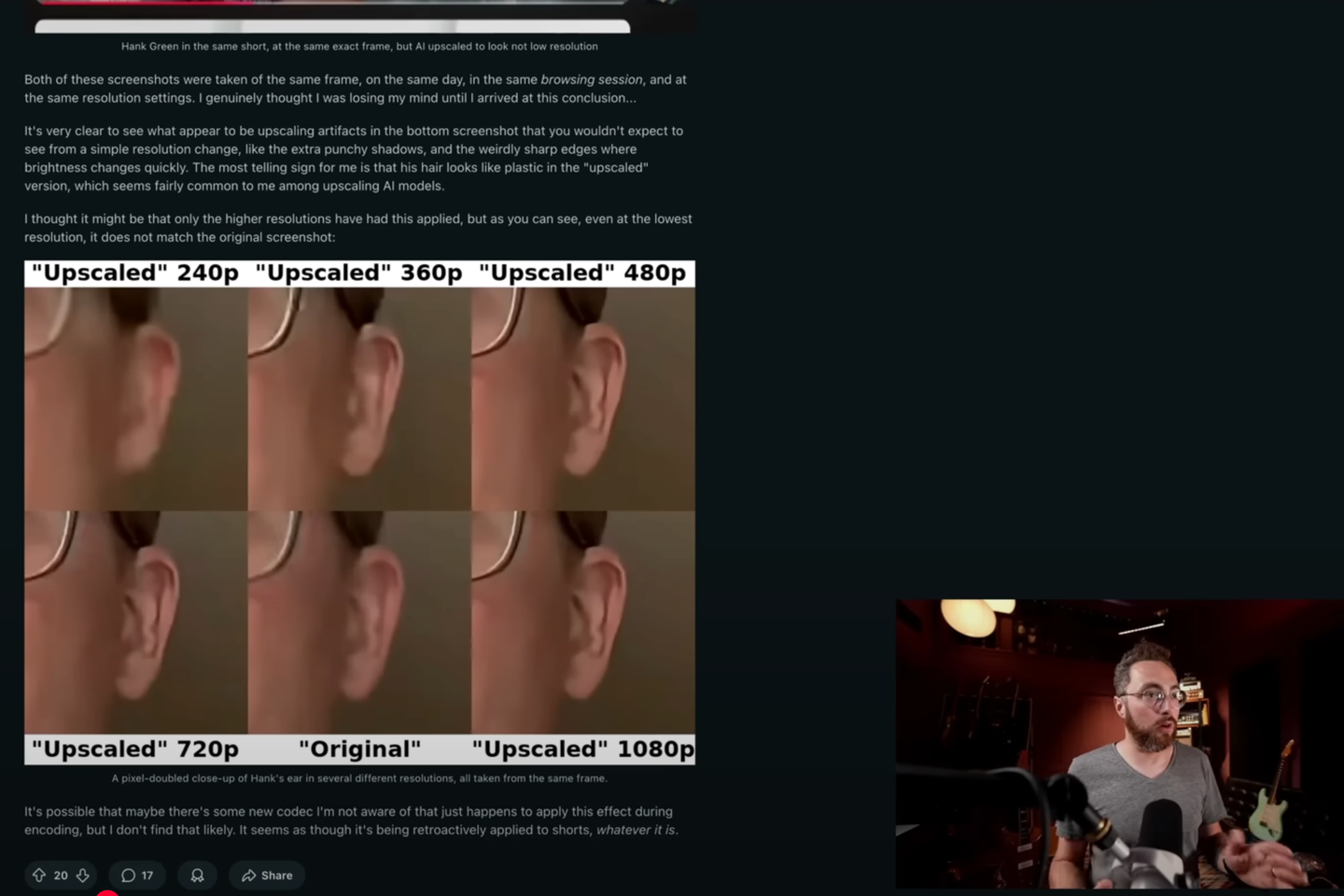

YouTube accusé d’appliquer des filtres sous IA aux contenus des utilisateurs

Dès le mois de juin, les premiers avertissements inquiets commencent à apparaître sur le forum Reddit. Quelques créateurs s’alarment de l’apparence des vidéos publiées récemment sur YouTube : certains y décèlent un effet « peinture à l’huile », d’autres un aspect « plastique » leur faisant penser à la marque d’un traitement par intelligence artificielle. Toutefois, il faut attendre mercredi 20 août, cette fois sur le réseau social X, pour que le soupçon se confirme. En guise d’expérimentation, l’entreprise utilise bien un « procédé traditionnel de “machine learning”pour déflouter, “débruiter” et améliorer la clarté » d’une partie des « shorts », les vidéos courtes et verticales de YouTube, révèle alors Rene Ritchie, chargé pour YouTube des relations avec les créateurs. En employant le vocable « machine learning », la plateforme se garde d’employer les termes « intelligence artificielle », qui évoquent sans doute trop les IA génératives, outils apparus dans les années 2020 et qui permettent de créer des vidéos de toutes pièces sur la base d’une simple consigne textuelle. A l’inverse, le « machine learning » peut passer pour une technologie plus traditionnelle, car il est Lire aussi | Article réservé à nos abonnés Avec Veo 3, les vidéos générées par IA deviennent quasiment impossibles à distinguer des vraies Ce type d’outil est pourtant bien une intelligence artificielle. Il partage même avec les IA génératives des soubassements techniques communs de sorte qu’il ne serait pas surprenant que leurs signatures visuelles respectives puissent être confondues. Perte de confiance C’est la raison pour laquelle les nouveaux filtres de YouTube font craindre aux créateurs des conséquences négatives sur leur communauté. « J’ai un énorme problème avec ça », réagit ainsi Rhett Shull, youtubeur qui compte près de 750 000 abonnés. « En ce moment, l’IA est au cœur d’un vif débat. Des personnes sont farouchement hostiles à cette technologie, à cause de son impact environnemental » et des questions de propriété intellectuelle qu’elle soulève, expliquait-il dans une vidéo publiée vendredi 15 août. Il vous reste 45.32% de cet article à lire. La suite est réservée aux abonnés.

#youtube #accusé #dappliquer #des #filtresYouTube accusé d’appliquer des filtres sous IA aux contenus des utilisateursDès le mois de juin, les premiers avertissements inquiets commencent à apparaître sur le forum Reddit. Quelques créateurs s’alarment de l’apparence des vidéos publiées récemment sur YouTube : certains y décèlent un effet « peinture à l’huile », d’autres un aspect « plastique » leur faisant penser à la marque d’un traitement par intelligence artificielle. Toutefois, il faut attendre mercredi 20 août, cette fois sur le réseau social X, pour que le soupçon se confirme. En guise d’expérimentation, l’entreprise utilise bien un « procédé traditionnel de “machine learning”pour déflouter, “débruiter” et améliorer la clarté » d’une partie des « shorts », les vidéos courtes et verticales de YouTube, révèle alors Rene Ritchie, chargé pour YouTube des relations avec les créateurs. En employant le vocable « machine learning », la plateforme se garde d’employer les termes « intelligence artificielle », qui évoquent sans doute trop les IA génératives, outils apparus dans les années 2020 et qui permettent de créer des vidéos de toutes pièces sur la base d’une simple consigne textuelle. A l’inverse, le « machine learning » peut passer pour une technologie plus traditionnelle, car il est Lire aussi | Article réservé à nos abonnés Avec Veo 3, les vidéos générées par IA deviennent quasiment impossibles à distinguer des vraies Ce type d’outil est pourtant bien une intelligence artificielle. Il partage même avec les IA génératives des soubassements techniques communs de sorte qu’il ne serait pas surprenant que leurs signatures visuelles respectives puissent être confondues. Perte de confiance C’est la raison pour laquelle les nouveaux filtres de YouTube font craindre aux créateurs des conséquences négatives sur leur communauté. « J’ai un énorme problème avec ça », réagit ainsi Rhett Shull, youtubeur qui compte près de 750 000 abonnés. « En ce moment, l’IA est au cœur d’un vif débat. Des personnes sont farouchement hostiles à cette technologie, à cause de son impact environnemental » et des questions de propriété intellectuelle qu’elle soulève, expliquait-il dans une vidéo publiée vendredi 15 août. Il vous reste 45.32% de cet article à lire. La suite est réservée aux abonnés. #youtube #accusé #dappliquer #des #filtres· 2 Comments ·0 Shares

830

830

-

L’ONU se dote d’un groupe d’experts scientifiques sur l’intelligence artificielle

Le stand Amazon Web Services à la Hannover Messe, l’une des plus grandes foires industrielles du monde, à Hanovre, en Allemagne, le 30 mars 2025. FABIAN BIMMER / REUTERS L’Assemblée générale de l’Organisation des Nations uniesa créé, mardi 26 août, un groupe d’experts scientifiques sur l’intelligence artificiellequi sera chargé d’aider la communauté internationale à prendre des décisions informées sur ce sujet sensible, comme le fait le Groupe d’experts intergouvernemental sur l’évolution du climat. S’inquiétant du développement rapide de technologies révolutionnaires qui pourraient menacer la démocratie et les droits humains, les Etats membres de l’ONU s’étaient engagés, en septembre 2024, dans le « Pacte pour l’avenir », à mettre en place un tel groupe d’experts pour éclairer le dialogue international entre gouvernements et autres acteurs du secteur. Dans une résolution adoptée mardi, l’Assemblée générale a formellement créé ce « Groupe scientifique international indépendant de l’intelligence artificielle » qui devra fournir des « évaluations scientifiques fondées sur des données probantes dans lesquelles seront synthétisées et analysées les études existantes sur les promesses, les risques et les répercussions de l’intelligence artificielle ». Son rapport de synthèse annuel « servira à éclairer la prise de décisions, sans toutefois être prescriptif », précise le texte. Lire aussi | Article réservé à nos abonnés De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA « Pont crucial » Mandaté par l’Assemblée, le secrétaire général de l’ONU, Antonio Guterres, qui a salué la création d’un « pont crucial entre la recherche de pointe sur l’IA et l’élaboration des politiques », va désormais lancer un appel à candidatures pour identifier les quarante futurs membres du groupe, qui siégeront pour un mandat de trois ans. « L’intelligence artificielle se développe à un rythme et à une échelle qui affectent tous les pays », a commenté la représentante permanente du Costa Rica auprès de l’ONU, Maritza Chan Valverde, qui a supervisé les négociations avec son homologue espagnol. « Avec cette résolution, les Nations unies réaffirment leur rôle central pour garantir que l’IA sera au service de l’humanité », a-t-elle insisté. « En fournissant des évaluations scientifiques rigoureuses et indépendantes,aidera la communauté internationale à anticiper les défis émergents et à prendre des décisions informées sur comment régir cette technologie transformatrice », a commenté le porte-parole du secrétaire général, Stéphane Dujarric. Le Monde avec AFP

#lonu #dote #dun #groupe #dexpertsL’ONU se dote d’un groupe d’experts scientifiques sur l’intelligence artificielleLe stand Amazon Web Services à la Hannover Messe, l’une des plus grandes foires industrielles du monde, à Hanovre, en Allemagne, le 30 mars 2025. FABIAN BIMMER / REUTERS L’Assemblée générale de l’Organisation des Nations uniesa créé, mardi 26 août, un groupe d’experts scientifiques sur l’intelligence artificiellequi sera chargé d’aider la communauté internationale à prendre des décisions informées sur ce sujet sensible, comme le fait le Groupe d’experts intergouvernemental sur l’évolution du climat. S’inquiétant du développement rapide de technologies révolutionnaires qui pourraient menacer la démocratie et les droits humains, les Etats membres de l’ONU s’étaient engagés, en septembre 2024, dans le « Pacte pour l’avenir », à mettre en place un tel groupe d’experts pour éclairer le dialogue international entre gouvernements et autres acteurs du secteur. Dans une résolution adoptée mardi, l’Assemblée générale a formellement créé ce « Groupe scientifique international indépendant de l’intelligence artificielle » qui devra fournir des « évaluations scientifiques fondées sur des données probantes dans lesquelles seront synthétisées et analysées les études existantes sur les promesses, les risques et les répercussions de l’intelligence artificielle ». Son rapport de synthèse annuel « servira à éclairer la prise de décisions, sans toutefois être prescriptif », précise le texte. Lire aussi | Article réservé à nos abonnés De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA « Pont crucial » Mandaté par l’Assemblée, le secrétaire général de l’ONU, Antonio Guterres, qui a salué la création d’un « pont crucial entre la recherche de pointe sur l’IA et l’élaboration des politiques », va désormais lancer un appel à candidatures pour identifier les quarante futurs membres du groupe, qui siégeront pour un mandat de trois ans. « L’intelligence artificielle se développe à un rythme et à une échelle qui affectent tous les pays », a commenté la représentante permanente du Costa Rica auprès de l’ONU, Maritza Chan Valverde, qui a supervisé les négociations avec son homologue espagnol. « Avec cette résolution, les Nations unies réaffirment leur rôle central pour garantir que l’IA sera au service de l’humanité », a-t-elle insisté. « En fournissant des évaluations scientifiques rigoureuses et indépendantes,aidera la communauté internationale à anticiper les défis émergents et à prendre des décisions informées sur comment régir cette technologie transformatrice », a commenté le porte-parole du secrétaire général, Stéphane Dujarric. Le Monde avec AFP #lonu #dote #dun #groupe #dexperts· 2 Comments ·0 Shares

762

762

-

Elon Musk porte plainte contre Apple et OpenAI qu’il accuse de pratiques anticoncurrentielles

Elon Musk à Grünheide, en Allemagne, le 22 mars 2022. PATRICK PLEUL/VIA REUTERS Le réseau social X et la start-up xAI, propriétés d’Elon Musk, ont porté plainte, lundi 25 août, contre Apple et OpenAI qu’ils accusent d’avoir formé une alliance illégale pour entraver la concurrence dans le domaine de l’intelligence artificiellegénérative sur les smartphones. Le milliardaire, qui a saisi une cour fédérale du Texas, affirme que le fabricant de l’iPhone et l’éditeur de ChatGPT se sont mis d’accord pour intégrer l’assistant IA aux smartphones d’Apple, tout en écartant des rivaux, comme Grok, l’assistant IA de xAI. « C’est l’histoire de deux monopoles qui unissent leurs forces pour assurer leur domination continue dans un monde désormais propulsé par la technologie la plus puissante jamais créée par l’humanité : l’intelligence artificielle », peut-on lire dans la plainte. X et xAI affirment qu’Apple détient 65 % du marché des smartphones aux Etats-Unis, tandis qu’OpenAI contrôlerait au moins 80 % du marché des assistants d’IA générative, grâce à ChatGPT. Apple et OpenAI ont annoncé leur partenariat en juin 2024, intégrant le célèbre assistant à certaines fonctionnalités de l’iPhone, notamment son assistant vocal Siri. Selon la plainte, cet accord donnerait à ChatGPT un accès exclusif à « des milliards de requêtes d’utilisateurs » provenant de centaines de millions d’appareils. Elon Musk accuse également Apple de manipuler le classement de sa plateforme de téléchargement des applications mobilespour favoriser l’application ChatGPT, tout en retardant l’approbation des mises à jour de l’application Grok. Ses entreprises réclament plusieurs milliards de dollars de dommages et intérêts ainsi qu’une injonction permanente pour mettre fin aux pratiques anticoncurrentielles qu’elles dénoncent. Lire aussi | Article réservé à nos abonnés Intelligence artificielle : les échanges aigres-doux entre Sam Altman et Mark Zuckerberg, nouveaux rivaux de la tech « Campagne acharnée » « Cette nouvelle plainte correspond bien au comportement récurrent de M. Musk, caractérisé par le harcèlement », a réagi un porte-parole d’OpenAI. Apple n’a pas répondu à une sollicitation de l’Agence France-Presse. Elon Musk a fait partie de l’équipe de onze personnes qui a fondé OpenAI en 2015, mais il a quitté l’entreprise en 2018 et ne cesse de l’attaquer sur X et devant les tribunaux depuis le succès phénoménal de ChatGPT à la fin de 2022. Il a entrepris une action en justice contre la star de la Silicon Valley qui aurait, selon lui, trahi ses valeurs, mais a aussi proposé de la racheter. OpenAI a riposté en avril avec une plainte contre le milliardaire, l’accusant de mener une « campagne acharnée » pour lui nuire. Newsletter Newsletter Le Monde Newsletter Suivez-nous sur WhatsApp Ce mois-ci, Elon Musk s’en est pris à Apple : « Apple agit de manière à rendre impossible pour toute entreprise d’IA autre qu’OpenAI d’atteindre la première place sur l’App Store, ce qui constitue une violation manifeste des règles de concurrence », a lancé le milliardaire sur X. Ces accusations ont provoqué une passe d’armes avec Sam Altman, cofondateur et patron d’OpenAI. « C’est une affirmation remarquable, compte tenu de ce que j’ai entendu dire à propos d’Elon, qui manipulerait X pour son propre bénéfice et celui de ses entreprises et pour nuire à ses concurrents ainsi qu’aux personnes qu’il n’apprécie pas », a-t-il réagi sur X. Sam Altman « ment comme il respire », a renchéri Elon Musk, qualifiant son message de « connerie ». Lire aussi | Article réservé à nos abonnés De Mark Zuckerberg à Elon Musk, le « boys club » de Palo Alto Le Monde avec AFP Réutiliser ce contenu

#elon #musk #porte #plainte #contreElon Musk porte plainte contre Apple et OpenAI qu’il accuse de pratiques anticoncurrentiellesElon Musk à Grünheide, en Allemagne, le 22 mars 2022. PATRICK PLEUL/VIA REUTERS Le réseau social X et la start-up xAI, propriétés d’Elon Musk, ont porté plainte, lundi 25 août, contre Apple et OpenAI qu’ils accusent d’avoir formé une alliance illégale pour entraver la concurrence dans le domaine de l’intelligence artificiellegénérative sur les smartphones. Le milliardaire, qui a saisi une cour fédérale du Texas, affirme que le fabricant de l’iPhone et l’éditeur de ChatGPT se sont mis d’accord pour intégrer l’assistant IA aux smartphones d’Apple, tout en écartant des rivaux, comme Grok, l’assistant IA de xAI. « C’est l’histoire de deux monopoles qui unissent leurs forces pour assurer leur domination continue dans un monde désormais propulsé par la technologie la plus puissante jamais créée par l’humanité : l’intelligence artificielle », peut-on lire dans la plainte. X et xAI affirment qu’Apple détient 65 % du marché des smartphones aux Etats-Unis, tandis qu’OpenAI contrôlerait au moins 80 % du marché des assistants d’IA générative, grâce à ChatGPT. Apple et OpenAI ont annoncé leur partenariat en juin 2024, intégrant le célèbre assistant à certaines fonctionnalités de l’iPhone, notamment son assistant vocal Siri. Selon la plainte, cet accord donnerait à ChatGPT un accès exclusif à « des milliards de requêtes d’utilisateurs » provenant de centaines de millions d’appareils. Elon Musk accuse également Apple de manipuler le classement de sa plateforme de téléchargement des applications mobilespour favoriser l’application ChatGPT, tout en retardant l’approbation des mises à jour de l’application Grok. Ses entreprises réclament plusieurs milliards de dollars de dommages et intérêts ainsi qu’une injonction permanente pour mettre fin aux pratiques anticoncurrentielles qu’elles dénoncent. Lire aussi | Article réservé à nos abonnés Intelligence artificielle : les échanges aigres-doux entre Sam Altman et Mark Zuckerberg, nouveaux rivaux de la tech « Campagne acharnée » « Cette nouvelle plainte correspond bien au comportement récurrent de M. Musk, caractérisé par le harcèlement », a réagi un porte-parole d’OpenAI. Apple n’a pas répondu à une sollicitation de l’Agence France-Presse. Elon Musk a fait partie de l’équipe de onze personnes qui a fondé OpenAI en 2015, mais il a quitté l’entreprise en 2018 et ne cesse de l’attaquer sur X et devant les tribunaux depuis le succès phénoménal de ChatGPT à la fin de 2022. Il a entrepris une action en justice contre la star de la Silicon Valley qui aurait, selon lui, trahi ses valeurs, mais a aussi proposé de la racheter. OpenAI a riposté en avril avec une plainte contre le milliardaire, l’accusant de mener une « campagne acharnée » pour lui nuire. Newsletter Newsletter Le Monde Newsletter Suivez-nous sur WhatsApp Ce mois-ci, Elon Musk s’en est pris à Apple : « Apple agit de manière à rendre impossible pour toute entreprise d’IA autre qu’OpenAI d’atteindre la première place sur l’App Store, ce qui constitue une violation manifeste des règles de concurrence », a lancé le milliardaire sur X. Ces accusations ont provoqué une passe d’armes avec Sam Altman, cofondateur et patron d’OpenAI. « C’est une affirmation remarquable, compte tenu de ce que j’ai entendu dire à propos d’Elon, qui manipulerait X pour son propre bénéfice et celui de ses entreprises et pour nuire à ses concurrents ainsi qu’aux personnes qu’il n’apprécie pas », a-t-il réagi sur X. Sam Altman « ment comme il respire », a renchéri Elon Musk, qualifiant son message de « connerie ». Lire aussi | Article réservé à nos abonnés De Mark Zuckerberg à Elon Musk, le « boys club » de Palo Alto Le Monde avec AFP Réutiliser ce contenu #elon #musk #porte #plainte #contre· 2 Comments ·0 Shares

645

645

-

De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA

SOLÈNE REVENEY / « LE MONDE » C’est un paradoxe dans lequel bien des éditeurs d’intelligences artificiellessont empêtrés : pourquoi investir tant d’argent et d’efforts dans la création d’IA plus sûres et plus neutres si, une fois commercialisés, ces robots conversationnels peuvent être largement dévoyés ? Prenons le cas d’OpenAI. En avril, l’éditeur de ChatGPT dit réfléchir publiquement à rendre son robot conversationnel moins obséquieux, car il risque d’engager des personnes fragiles dans une dépendance malsaine, selon le constat dressé par ses propres chercheurs un mois auparavant. Plusieurs affaires médiatiques, rapportées notamment par le New York Times, Ars Technica, Futurism ou l’agence Reuters, ont illustré la dangereuse spirale dans laquelle certains utilisateurs peuvent tomber, avec à la clé un décrochage parfois fatal avec la réalité. Alors le 7 août, OpenAI saute le pas, annonçant une nouvelle version de son robot, GPT-5. Son ton est résolument plus froid, et il surveille désormais la durée des conversations pour suggérer des pauses quand il le juge nécessaire. Lire aussi | Article réservé à nos abonnés ChatGPT : les débuts difficiles de GPT-5, le nouveau modèle de langage d’OpenAI, jugé moins efficace et moins « amical » L’entreprise applique ainsi deux recommandations-clés issues de chercheurs en IA parmi les plus critiques, dont des experts de Google, auteurs en 2024 d’une longue recension des dangers de l’IA. Dans ce document, ceux-ci anticipent un monde où la flatterie des robots réduit « les occasions qu’ont les humains de grandir et de se développerdevenir de meilleures versions d’eux-mêmes ». Voire « un monde où les utilisateurs abandonnent les interactions compliquées et imparfaitesavec les humains en faveur des échanges sans frictions fournis par les IA ». Il vous reste 73.15% de cet article à lire. La suite est réservée aux abonnés.

#meta #chatgpt #jeu #dangereux #duneDe Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IASOLÈNE REVENEY / « LE MONDE » C’est un paradoxe dans lequel bien des éditeurs d’intelligences artificiellessont empêtrés : pourquoi investir tant d’argent et d’efforts dans la création d’IA plus sûres et plus neutres si, une fois commercialisés, ces robots conversationnels peuvent être largement dévoyés ? Prenons le cas d’OpenAI. En avril, l’éditeur de ChatGPT dit réfléchir publiquement à rendre son robot conversationnel moins obséquieux, car il risque d’engager des personnes fragiles dans une dépendance malsaine, selon le constat dressé par ses propres chercheurs un mois auparavant. Plusieurs affaires médiatiques, rapportées notamment par le New York Times, Ars Technica, Futurism ou l’agence Reuters, ont illustré la dangereuse spirale dans laquelle certains utilisateurs peuvent tomber, avec à la clé un décrochage parfois fatal avec la réalité. Alors le 7 août, OpenAI saute le pas, annonçant une nouvelle version de son robot, GPT-5. Son ton est résolument plus froid, et il surveille désormais la durée des conversations pour suggérer des pauses quand il le juge nécessaire. Lire aussi | Article réservé à nos abonnés ChatGPT : les débuts difficiles de GPT-5, le nouveau modèle de langage d’OpenAI, jugé moins efficace et moins « amical » L’entreprise applique ainsi deux recommandations-clés issues de chercheurs en IA parmi les plus critiques, dont des experts de Google, auteurs en 2024 d’une longue recension des dangers de l’IA. Dans ce document, ceux-ci anticipent un monde où la flatterie des robots réduit « les occasions qu’ont les humains de grandir et de se développerdevenir de meilleures versions d’eux-mêmes ». Voire « un monde où les utilisateurs abandonnent les interactions compliquées et imparfaitesavec les humains en faveur des échanges sans frictions fournis par les IA ». Il vous reste 73.15% de cet article à lire. La suite est réservée aux abonnés. #meta #chatgpt #jeu #dangereux #dune· 2 Comments ·0 Shares

542

542

-

Intelligence artificielle : les économistes s’inquiètent d’un risque de bulle financière

Des investissements mirobolants, des valorisations boursières extravagantes et trop peu de profits pour l’instant, à l’exception du fabricant de microprocesseurs Nvidia : la folie de l’intelligence artificielleest-elle en passe de se transformer en bulle financière ? C’est la mise en garde lancée mi-août par Sam Altman, le PDG d’OpenAI. « Si l’on considère la plupart des bulles financières de l’histoire, comme la bulle Internet, on constate qu’il y avait une réalité : Internet était un phénomène majeur, les gens étaient surexcités. Sommes-nous dans une phase où les investisseurs dans leur ensemble sont surexcités par l’IA ? Je pense que oui. L’IA est-elle la chose la plus importante à venir depuis très longtemps ? Je pense que oui également », a-t-il déclaré à des journalistes américains. Lire aussi | Article réservé à nos abonnés IA : Donald Trump lâche la bride à la Silicon Valley pour assurer aux Etats-Unis « une domination mondiale » L’inquiétude est de plus en plus partagée. « Je m’attends à un krach »,Technological Revolutions and Financial Capital : The Dynamics of Bubbles and Golden Ages, « révolutions technologiques et capital financier, les dynamiques des bulles et des âges d’or »,« Des trois acteurs en jeu, les investisseurs, les entreprises d’IA et les utilisateurs, les seuls à réaliser des profits sont les acteurs financiers dont les valorisations augmentent. C’est une situation de bulle typique : des plus-values élevées et des profits faibles. » L’affaire a un petit goût de déjà-vu pour l’économiste, réputée pour ses travaux sur l’innovation, qui a examiné les cinq révolutions industrielles majeures : le métier à tisser mû par un moulin à aubes en Angleterre, la locomotive à vapeur de George Stephenson, l’acier d’Andrew Carnegie à Pittsburgh, la chaîne d’assemblage de Fordet le premier microprocesseur Intel. Toutes ont révolutionné l’Occident. Lire aussi | Article réservé à nos abonnés Après le métavers, Mark Zuckerberg investit des dizaines de milliards de dollars dans la « superintelligence » grâce à ses résultats mirobolants Mais avant de s’installer durablement et de diffuser leurs effets à l’économie, ces innovations ont provoqué une frénésie d’investissements – trop de canaux en Angleterre, trop de chemins de fer peu rentables — et de spéculation financière détachée des réalités, provoquant krachs ou corrections boursières. Beaucoup, sur les marchés, ont en mémoire l’éclatement de la bulle Internet en l’an 2000. « La bulle de l’IA est aujourd’hui plus importante que celle des technologies de l’information des années 1990 », estimait mi-juillet Torsten Slok, économiste en chef du fonds Apollo. Il vous reste 73.74% de cet article à lire. La suite est réservée aux abonnés.

#intelligence #artificielle #les #économistes #sinquiètentIntelligence artificielle : les économistes s’inquiètent d’un risque de bulle financièreDes investissements mirobolants, des valorisations boursières extravagantes et trop peu de profits pour l’instant, à l’exception du fabricant de microprocesseurs Nvidia : la folie de l’intelligence artificielleest-elle en passe de se transformer en bulle financière ? C’est la mise en garde lancée mi-août par Sam Altman, le PDG d’OpenAI. « Si l’on considère la plupart des bulles financières de l’histoire, comme la bulle Internet, on constate qu’il y avait une réalité : Internet était un phénomène majeur, les gens étaient surexcités. Sommes-nous dans une phase où les investisseurs dans leur ensemble sont surexcités par l’IA ? Je pense que oui. L’IA est-elle la chose la plus importante à venir depuis très longtemps ? Je pense que oui également », a-t-il déclaré à des journalistes américains. Lire aussi | Article réservé à nos abonnés IA : Donald Trump lâche la bride à la Silicon Valley pour assurer aux Etats-Unis « une domination mondiale » L’inquiétude est de plus en plus partagée. « Je m’attends à un krach »,Technological Revolutions and Financial Capital : The Dynamics of Bubbles and Golden Ages, « révolutions technologiques et capital financier, les dynamiques des bulles et des âges d’or »,« Des trois acteurs en jeu, les investisseurs, les entreprises d’IA et les utilisateurs, les seuls à réaliser des profits sont les acteurs financiers dont les valorisations augmentent. C’est une situation de bulle typique : des plus-values élevées et des profits faibles. » L’affaire a un petit goût de déjà-vu pour l’économiste, réputée pour ses travaux sur l’innovation, qui a examiné les cinq révolutions industrielles majeures : le métier à tisser mû par un moulin à aubes en Angleterre, la locomotive à vapeur de George Stephenson, l’acier d’Andrew Carnegie à Pittsburgh, la chaîne d’assemblage de Fordet le premier microprocesseur Intel. Toutes ont révolutionné l’Occident. Lire aussi | Article réservé à nos abonnés Après le métavers, Mark Zuckerberg investit des dizaines de milliards de dollars dans la « superintelligence » grâce à ses résultats mirobolants Mais avant de s’installer durablement et de diffuser leurs effets à l’économie, ces innovations ont provoqué une frénésie d’investissements – trop de canaux en Angleterre, trop de chemins de fer peu rentables — et de spéculation financière détachée des réalités, provoquant krachs ou corrections boursières. Beaucoup, sur les marchés, ont en mémoire l’éclatement de la bulle Internet en l’an 2000. « La bulle de l’IA est aujourd’hui plus importante que celle des technologies de l’information des années 1990 », estimait mi-juillet Torsten Slok, économiste en chef du fonds Apollo. Il vous reste 73.74% de cet article à lire. La suite est réservée aux abonnés. #intelligence #artificielle #les #économistes #sinquiètent· 2 Comments ·0 Shares

950

950

-

L’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyens

L’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyens Le champion américain de l’analyse des données est mis en cause par le « New York Times » et des sénateurs démocrates pour des pratiques illégales. Mais ce genre de dispositifs n’est pas l’apanage des Etats-Unis. Article réservé aux abonnés Alex Karp, patron de Palantir Technologies, lors d’une table ronde intitulée « Pouvoir, finalité et le nouveau siècle américain » au Hill and Valley Forum, à Washington, le 30 avril 2025. KEVIN DIETSCH/GETTY IMAGES VIA AFP « Un cauchemar de surveillance. » C’est le climat dystopique qu’encouragerait l’entreprise Palantir, selon des sénateurs américains démocrates. Dans une lettre adressée le 18 juin à Alex Karp, l’impétueux patron de Palantir, ces derniers réclament des comptes au géant américain de l’analyse de données sur la teneur des contrats qu’il a signés avec l’administration Trump. Lire aussi l’enquête | Article réservé à nos abonnés La discrète montée en puissance de la reconnaissance faciale dans le monde D’après l’enquête du New York Times, parue le 30 mai, le gouvernement aurait confié à la multinationale la mission de créer une base fusionnant un grand nombre d’informations sur la vie privée des citoyens américains, à travers un produit nommé « Foundry » qui analyse les données d’administrations fédérales. Des pratiques contraires à la législation des Etats-Unis que Palantir a niées. Mais les élus sont revenus à la charge en dénonçant notamment le contrat de la société avec l’Internal Revenue Service, source des données sensibles de tous les foyers imposables américains. Plus récemment, Palantir a également signé un contrat de 30 millions de dollarsavec l’agence de police douanière et de contrôle des frontièrespour rationaliser, selon les autorités, l’« identification » des étrangers et leur « éloignement » des Etats-Unis, dans le but de rendre la « logistique d’expulsion » plus efficace. Il vous reste 59.16% de cet article à lire. La suite est réservée aux abonnés.

#lentreprise #américaine #palantir #suspectée #créerL’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyensL’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyens Le champion américain de l’analyse des données est mis en cause par le « New York Times » et des sénateurs démocrates pour des pratiques illégales. Mais ce genre de dispositifs n’est pas l’apanage des Etats-Unis. Article réservé aux abonnés Alex Karp, patron de Palantir Technologies, lors d’une table ronde intitulée « Pouvoir, finalité et le nouveau siècle américain » au Hill and Valley Forum, à Washington, le 30 avril 2025. KEVIN DIETSCH/GETTY IMAGES VIA AFP « Un cauchemar de surveillance. » C’est le climat dystopique qu’encouragerait l’entreprise Palantir, selon des sénateurs américains démocrates. Dans une lettre adressée le 18 juin à Alex Karp, l’impétueux patron de Palantir, ces derniers réclament des comptes au géant américain de l’analyse de données sur la teneur des contrats qu’il a signés avec l’administration Trump. Lire aussi l’enquête | Article réservé à nos abonnés La discrète montée en puissance de la reconnaissance faciale dans le monde D’après l’enquête du New York Times, parue le 30 mai, le gouvernement aurait confié à la multinationale la mission de créer une base fusionnant un grand nombre d’informations sur la vie privée des citoyens américains, à travers un produit nommé « Foundry » qui analyse les données d’administrations fédérales. Des pratiques contraires à la législation des Etats-Unis que Palantir a niées. Mais les élus sont revenus à la charge en dénonçant notamment le contrat de la société avec l’Internal Revenue Service, source des données sensibles de tous les foyers imposables américains. Plus récemment, Palantir a également signé un contrat de 30 millions de dollarsavec l’agence de police douanière et de contrôle des frontièrespour rationaliser, selon les autorités, l’« identification » des étrangers et leur « éloignement » des Etats-Unis, dans le but de rendre la « logistique d’expulsion » plus efficace. Il vous reste 59.16% de cet article à lire. La suite est réservée aux abonnés. #lentreprise #américaine #palantir #suspectée #créer· 2 Comments ·0 Shares

413

413

-

« En choisissant l’IA pour sa politique mémorielle, le gouvernement automatise un travail intellectuel »

Le 27 mai, Journée nationale de la Résistance, le gouvernement français a publié une vidéo retraçant la vie d’une résistante sous l’Occupation. Générée à l’aide d’une intelligence artificielle, elle est historiquement aberrante, se terminant notamment par une scène de la Libération où apparaît un soldat de la Wehrmacht. Critiquée pour abolir la frontière entre le vrai et le faux, elle a été retirée. Le service d’information du gouvernement avait déjà fait appel à une IA à des fins commémoratives quelques semaines plus tôt : une publication « artificielle », toujours en ligne sur TikTok, commémorait le droit de vote des femmes, figurant une France de 1945 esthétisée, sans aucune trace de la guerre, et montrant, outre d’autres incohérences, un France-Journal qui n’a jamais existé. Pour comprendre ces représentations absurdes, rappelons comment les IA génératives fonctionnent. Des jeux de données massifs sont utilisés pour leur création après une phase d’entraînement dont sont déduits des motifs statistiquement significatifs, qui servent ensuite à créer des textes, des images et des vidéos. Cette logique est probabiliste : ce sont des perroquets stochastiques, c’est-à-dire imprévisibles. Lire aussi le décryptage | Article réservé à nos abonnés Les IA, des « boîtes noires » dont les chercheurs tentent de déchiffrer le fonctionnement Les IA génératives, capables de créer des documents imitant les traces du passé, instaurent ainsi une médiation nouvelle entre nous et notre histoire, fondamentalement différente de celle opérée par les archivistes, les historiens et les historiennes. Ainsi, une requête entrée pour générer une vidéo sur une résistante française active des motifs liés à la seconde guerre mondiale : l’apparition d’un soldatde la Wehrmacht est statistiquement pertinente, mais incohérente à la Libération. LÉA GIRARDOT / LE MONDE Il vous reste 52.13% de cet article à lire. La suite est réservée aux abonnés.

#choisissant #lia #pour #politique #mémorielle« En choisissant l’IA pour sa politique mémorielle, le gouvernement automatise un travail intellectuel »Le 27 mai, Journée nationale de la Résistance, le gouvernement français a publié une vidéo retraçant la vie d’une résistante sous l’Occupation. Générée à l’aide d’une intelligence artificielle, elle est historiquement aberrante, se terminant notamment par une scène de la Libération où apparaît un soldat de la Wehrmacht. Critiquée pour abolir la frontière entre le vrai et le faux, elle a été retirée. Le service d’information du gouvernement avait déjà fait appel à une IA à des fins commémoratives quelques semaines plus tôt : une publication « artificielle », toujours en ligne sur TikTok, commémorait le droit de vote des femmes, figurant une France de 1945 esthétisée, sans aucune trace de la guerre, et montrant, outre d’autres incohérences, un France-Journal qui n’a jamais existé. Pour comprendre ces représentations absurdes, rappelons comment les IA génératives fonctionnent. Des jeux de données massifs sont utilisés pour leur création après une phase d’entraînement dont sont déduits des motifs statistiquement significatifs, qui servent ensuite à créer des textes, des images et des vidéos. Cette logique est probabiliste : ce sont des perroquets stochastiques, c’est-à-dire imprévisibles. Lire aussi le décryptage | Article réservé à nos abonnés Les IA, des « boîtes noires » dont les chercheurs tentent de déchiffrer le fonctionnement Les IA génératives, capables de créer des documents imitant les traces du passé, instaurent ainsi une médiation nouvelle entre nous et notre histoire, fondamentalement différente de celle opérée par les archivistes, les historiens et les historiennes. Ainsi, une requête entrée pour générer une vidéo sur une résistante française active des motifs liés à la seconde guerre mondiale : l’apparition d’un soldatde la Wehrmacht est statistiquement pertinente, mais incohérente à la Libération. LÉA GIRARDOT / LE MONDE Il vous reste 52.13% de cet article à lire. La suite est réservée aux abonnés. #choisissant #lia #pour #politique #mémorielle· 2 Comments ·0 Shares

481

481

-

Sébastien Crozier, syndicaliste : « Standardiser la voix, c’est nier qu’une intonation est souvent une histoire »

Sous prétexte d’amélioration, une vague d’outils d’analyse vocale déferle dans les entreprises. L’intelligence artificiellepromet plus d’objectivité et de performance. En réalité, c’est un travail placé sous surveillance émotionnelle. « Votre appel peut être enregistré à des fins de formation » : cette phrase familière camoufle désormais bien plus qu’un simple enregistrement. Derrière la collecte, il y a l’analyse ; derrière l’analyse, une interprétation ; et derrière l’interprétation, une intention. Le speech analytics, qui détecte stress, fatigue, doute ou enthousiasme, sort des centres d’appels pour pénétrer nos services internes, nos interactions professionnelles, nos entretiens d’évaluation… Les outils attribuent des scores, déclenchent des alertes. Demain, ils pourraient recommander promotions ou sanctions. La voix devient une simple donnée biométrique. Pourtant, elle n’est pas qu’un signal. Elle vibre, hésite, tremble, reflète nos journées, nos doutes, nos émotions. La standardiser, c’est nier qu’une intonation est souvent une histoire. Jugée « inappropriée » ? Alerte. Rythme jugé trop lent ? Risque de désengagement. Ton jugé trop vif ? Possible tension. Les autorités françaises et européennes l’ont compris : la voix est une donnée hautement sensible, permettant d’identifier une personne, mais aussi d’inférer son état émotionnel ou psychologique. Son traitement est interdit, sauf consentement libre et éclairé, ainsi que le prévoit le règlement général sur la protection des données– bientôt renforcé par l’IA Act. Mais en entreprise, que vaut ce consentement « libre » ? Peut-on refuser un outil imposé par la hiérarchie, comprendre ce que l’algorithme « a entendu » ou même contester ses conclusions ? Le consentement n’est pas une simple case à cocher, mais un droit fondamental. Lire aussi | Article réservé à nos abonnés L’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyens De nombreuses études confirment les risques : stress accru des salariés sous écoute permanente, autocensure, affaiblissement des échanges spontanés, rupture de confiance, déshumanisation du travail. S’y ajoutent des biais matériels ou algorithmiques, comme la compression numérique, le filtrage des fréquences, l’altération du timbre par les réseaux téléphoniques ou par VoIP, qui pénalisant certains accents, voix féminines ou styles culturels. Il vous reste 50.04% de cet article à lire. La suite est réservée aux abonnés.

#sébastien #crozier #syndicaliste #standardiser #voixSébastien Crozier, syndicaliste : « Standardiser la voix, c’est nier qu’une intonation est souvent une histoire »Sous prétexte d’amélioration, une vague d’outils d’analyse vocale déferle dans les entreprises. L’intelligence artificiellepromet plus d’objectivité et de performance. En réalité, c’est un travail placé sous surveillance émotionnelle. « Votre appel peut être enregistré à des fins de formation » : cette phrase familière camoufle désormais bien plus qu’un simple enregistrement. Derrière la collecte, il y a l’analyse ; derrière l’analyse, une interprétation ; et derrière l’interprétation, une intention. Le speech analytics, qui détecte stress, fatigue, doute ou enthousiasme, sort des centres d’appels pour pénétrer nos services internes, nos interactions professionnelles, nos entretiens d’évaluation… Les outils attribuent des scores, déclenchent des alertes. Demain, ils pourraient recommander promotions ou sanctions. La voix devient une simple donnée biométrique. Pourtant, elle n’est pas qu’un signal. Elle vibre, hésite, tremble, reflète nos journées, nos doutes, nos émotions. La standardiser, c’est nier qu’une intonation est souvent une histoire. Jugée « inappropriée » ? Alerte. Rythme jugé trop lent ? Risque de désengagement. Ton jugé trop vif ? Possible tension. Les autorités françaises et européennes l’ont compris : la voix est une donnée hautement sensible, permettant d’identifier une personne, mais aussi d’inférer son état émotionnel ou psychologique. Son traitement est interdit, sauf consentement libre et éclairé, ainsi que le prévoit le règlement général sur la protection des données– bientôt renforcé par l’IA Act. Mais en entreprise, que vaut ce consentement « libre » ? Peut-on refuser un outil imposé par la hiérarchie, comprendre ce que l’algorithme « a entendu » ou même contester ses conclusions ? Le consentement n’est pas une simple case à cocher, mais un droit fondamental. Lire aussi | Article réservé à nos abonnés L’entreprise américaine Palantir suspectée de créer une base de données géante sur les citoyens De nombreuses études confirment les risques : stress accru des salariés sous écoute permanente, autocensure, affaiblissement des échanges spontanés, rupture de confiance, déshumanisation du travail. S’y ajoutent des biais matériels ou algorithmiques, comme la compression numérique, le filtrage des fréquences, l’altération du timbre par les réseaux téléphoniques ou par VoIP, qui pénalisant certains accents, voix féminines ou styles culturels. Il vous reste 50.04% de cet article à lire. La suite est réservée aux abonnés. #sébastien #crozier #syndicaliste #standardiser #voix· 2 Comments ·0 Shares

444

444

-

Au Danemark, l’IA autorisée au baccalauréat à partir de 2026

Au Danemark, certains lycéens pourront utiliser l’intelligence artificielleà partir de 2026 pendant l’épreuve orale d’anglais du baccalauréat, a annoncé, vendredi 22 août, le ministère de l’éducation du pays scandinave. Lors de cet examen, les élèves pourront recourir à l’IA pendant la phase de préparation de l’oral : une fois le sujet tiré, chaque élève disposera d’une heure de préparation, au cours de laquelle « ilpermis d’utiliser tous les outils, y compris l’IA générative », ce qui n’était pas le cas jusqu’à présent. Il devra ensuite faire sa présentation orale devant l’examinateur. Le Danemark, qui autorise l’usage encadré d’Internet pendant les examens depuis 2008, cherche à encourager, à travers un cadre strict, le développement numérique dans les apprentissages. Lire aussi | Article réservé à nos abonnés « Nous sommes beaucoup trop pressés de confier à l’IA la gestion du monde au lieu de mesurer ses limites » « Nous lançons ces expérimentations afin de trouver le bon équilibre », a dit le ministre de l’éducation, Mattias Tesfaye, cité dans un communiqué. « Lorsque les élèves évoluent dans des mondes à la fois analogiques et numériques, nous les préparons de la meilleure manière possible à la réalité après l’école », a-t-il estimé. Cette expérience, qui est ouverte aux lycées qui se porteront volontaires, n’est valable qu’en ce qui concerne la filière générale. Lire aussi | Article réservé à nos abonnés L’IA, mes étudiants et moi : « Le semestre passé constitue la pire expérience de ma vie d’enseignant » Le Monde avec AFP Réutiliser ce contenu

#danemark #lia #autorisée #baccalauréat #partirAu Danemark, l’IA autorisée au baccalauréat à partir de 2026Au Danemark, certains lycéens pourront utiliser l’intelligence artificielleà partir de 2026 pendant l’épreuve orale d’anglais du baccalauréat, a annoncé, vendredi 22 août, le ministère de l’éducation du pays scandinave. Lors de cet examen, les élèves pourront recourir à l’IA pendant la phase de préparation de l’oral : une fois le sujet tiré, chaque élève disposera d’une heure de préparation, au cours de laquelle « ilpermis d’utiliser tous les outils, y compris l’IA générative », ce qui n’était pas le cas jusqu’à présent. Il devra ensuite faire sa présentation orale devant l’examinateur. Le Danemark, qui autorise l’usage encadré d’Internet pendant les examens depuis 2008, cherche à encourager, à travers un cadre strict, le développement numérique dans les apprentissages. Lire aussi | Article réservé à nos abonnés « Nous sommes beaucoup trop pressés de confier à l’IA la gestion du monde au lieu de mesurer ses limites » « Nous lançons ces expérimentations afin de trouver le bon équilibre », a dit le ministre de l’éducation, Mattias Tesfaye, cité dans un communiqué. « Lorsque les élèves évoluent dans des mondes à la fois analogiques et numériques, nous les préparons de la meilleure manière possible à la réalité après l’école », a-t-il estimé. Cette expérience, qui est ouverte aux lycées qui se porteront volontaires, n’est valable qu’en ce qui concerne la filière générale. Lire aussi | Article réservé à nos abonnés L’IA, mes étudiants et moi : « Le semestre passé constitue la pire expérience de ma vie d’enseignant » Le Monde avec AFP Réutiliser ce contenu #danemark #lia #autorisée #baccalauréat #partir· 2 Comments ·0 Shares

468

468

-

Adji Bousso Dieng, chercheuse en IA : « L’indépendance technologique de l’Afrique est menacée »

Adji Bousso Dieng au siège du Fonds monétaire international, à Washington le 13 avril 2023. BEHEEN PARVIN DABESTANI / WORLD BANK/ BEHEEN PARVIN DABEST Issue d’une famille modeste, Adji Bousso Dieng a grandi à Kaolack, au Sénégal, avant de partir étudier en France puis de s’installer aux Etats-Unis, où elle enseigne depuis 2021 les sciences et l’ingénierie à la prestigieuse université américaine de Princeton. Elle est la première professeure noire en informatique de cet établissement prestigieux. Panafricaniste revendiquée, la chercheuse en intelligence artificielle alerte sur la menace d’une « colonisation numérique » du continent. Votre parcours se déploie sur trois continents. Qu’est-ce qu’être africaine, pour vous, en 2025 ? C’est surtout être résilient. Etre née sur un continent qui affronte tant de chocs politiques, économiques et sociaux donne une grande force pour avancer. C’est ce qui m’a permis d’avoir confiance en moi dans un monde qui accorde peu de poids aux voix africaines. Vous avez grandi dans une famille nombreuse, sans votre père qui est mort dans votre prime enfance. Puis vous avez étudié en France avant de travailler aux Etats-Unis où vous avez été recrutée par Google. Comment expliquez-vous votre parcours ? Il vous reste 85.99% de cet article à lire. La suite est réservée aux abonnés.

#adji #bousso #dieng #chercheuse #lindépendanceAdji Bousso Dieng, chercheuse en IA : « L’indépendance technologique de l’Afrique est menacée »Adji Bousso Dieng au siège du Fonds monétaire international, à Washington le 13 avril 2023. BEHEEN PARVIN DABESTANI / WORLD BANK/ BEHEEN PARVIN DABEST Issue d’une famille modeste, Adji Bousso Dieng a grandi à Kaolack, au Sénégal, avant de partir étudier en France puis de s’installer aux Etats-Unis, où elle enseigne depuis 2021 les sciences et l’ingénierie à la prestigieuse université américaine de Princeton. Elle est la première professeure noire en informatique de cet établissement prestigieux. Panafricaniste revendiquée, la chercheuse en intelligence artificielle alerte sur la menace d’une « colonisation numérique » du continent. Votre parcours se déploie sur trois continents. Qu’est-ce qu’être africaine, pour vous, en 2025 ? C’est surtout être résilient. Etre née sur un continent qui affronte tant de chocs politiques, économiques et sociaux donne une grande force pour avancer. C’est ce qui m’a permis d’avoir confiance en moi dans un monde qui accorde peu de poids aux voix africaines. Vous avez grandi dans une famille nombreuse, sans votre père qui est mort dans votre prime enfance. Puis vous avez étudié en France avant de travailler aux Etats-Unis où vous avez été recrutée par Google. Comment expliquez-vous votre parcours ? Il vous reste 85.99% de cet article à lire. La suite est réservée aux abonnés. #adji #bousso #dieng #chercheuse #lindépendance2 Comments ·0 Shares -

Elon Musk accuse Apple de favoriser ChatGPT dans son App Store, au détriment de Grok

Apple se retrouve au milieu du champ de bataille entre Elon Musk, patron de xAI, et Sam Altman, PDG d’OpenAI. L’entreprise à la pomme est en effet accusée par le fondateur de SpaceX de favoritisme envers la maison mère de ChatGPT sur son magasin d’applications, l’App Store. « Apple agit de manière à rendre impossible pour toute entreprise d’IAautre qu’OpenAI d’atteindre la première place sur l’App Store, ce qui constitue une violation manifeste des règles de concurrence », a ainsi écrit Elon Musk sur son réseau social, X, mardi 13 août. Sa société xAI, qui a développé l’assistant IA Grok, « va immédiatement engager une action en justice », a-t-il ajouté. L’App Store permet de télécharger des applications sur les appareils d’Apple, comme ses iPhone. Cette plateforme est cruciale pour les éditeurs qui espèrent être choisis par les consommateurs. Apple, qui donne peu d’informations sur ses critères de sélection concernant les applications mises en avant, a assuré, jeudi 14 août, que sa plateforme de téléchargement était « équitable et exempte de tout parti pris ». « Nous mettons en avant des milliers d’applications via des classements, des recommandations algorithmiques et des sélections éditoriales effectuées par des experts selon des critères objectifs », a déclaré le créateur de l’iPhone dans un message transmis à l’Agence France-Presse par courriel. Des accusations non étayées L’App Store est, depuis longtemps, vivement critiquée par de nombreuses autorités et entreprises, notamment Epic Games, l’éditeur du jeu vidéo Fortnite. La plateforme est accusée, tout comme le Play Store de Google, d’abuser de sa position dominante pour s’imposer comme un passage obligé pour le téléchargement d’une application et les paiements, en prélevant des commissions importantes sur les dépenses des utilisateurs. Lire aussi | Google perd son appel contre Epic Games et doit réformer son magasin d’applications mobiles Cependant, rien à l’heure actuelle ne vient étayer les accusations portées par Elon Musk à l’encontre d’Apple, comme en témoignent les « notes de communautés » ajoutées au message posté par l’homme d’affaires, mardi. Grâce à cet outil, qui permet d’apporter des précisions ou des corrections à des messages trompeurs ou faux, des internautes font remarquer que certains outils d’IA, comme Deepseek ou Perplexity, ont réussi par le passé à se hisser parmi les applications les plus téléchargées sur l’App Store. Comme le fait remarquer le média spécialisé The Verge, on pourrait par ailleurs considérer que l’anomalie ne réside pas tant dans le classement actuel des applications X et Grok sur l’App Store que dans le fait qu’elles y figurent encore. L’approche très laxiste des deux applications en matière de modération fait qu’elles contreviennent régulièrement aux règles du magasin d’application, note le site spécialisé. Lire aussi | Article réservé à nos abonnés Grok, l’IA d’Elon Musk, encourage à voter Marine Le Pen et salue « l’efficacité » d’Adolf Hitler Croisade d’Elon Musk contre OpenAI Les accusations d’Elon Musk ont en tout cas déclenché une passe d’armes, sur X, entre Elon Musk et Sam Altman, véritable cible de cette nouvelle croisade du milliardaire d’extrême droite. « C’est une affirmation remarquable compte tenu de ce que j’ai entendu dire à propos d’Elon qui manipulerait X pour son propre bénéfice et celui de ses entreprises et pour nuire à ses concurrents ainsi qu’aux personnes qu’il n’apprécie pas », a notamment écrit le second. Sam Altman « ment comme il respire », a renchéri Elon Musk. Newsletter Newsletter Le Monde Newsletter Suivez-nous sur WhatsApp Le dirigeant de Tesla, SpaceX et X, entre autres entreprises, a fait partie de l’équipe de 11 personnes qui a fondé OpenAI en 2015. Mais il a quitté l’entreprise en 2018 et ne cesse de l’attaquer depuis le succès phénoménal de ChatGPT à la fin de 2022, y compris en justice. En retard dans l’IA générative, Apple a lancé en 2024 « Apple Intelligence », une série de fonctionnalités dopées à l’IA, notamment grâce à un accord avec OpenAI. Lire aussi | Article réservé à nos abonnés On a testé Apple Intelligence, les nouveaux outils d’IA déployés sur iOS 18.4 Le Monde avec AFP Réutiliser ce contenu