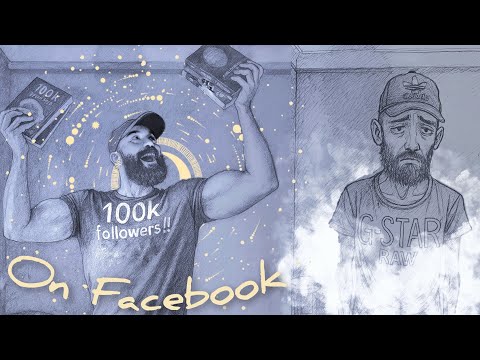

De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA

SOLÈNE REVENEY / « LE MONDE » C’est un paradoxe dans lequel bien des éditeurs d’intelligences artificiellessont empêtrés : pourquoi investir tant d’argent et d’efforts dans la création d’IA plus sûres et plus neutres si, une fois commercialisés, ces robots conversationnels peuvent être largement dévoyés ? Prenons le cas d’OpenAI. En avril, l’éditeur de ChatGPT dit réfléchir publiquement à rendre son robot conversationnel moins obséquieux, car il risque d’engager des personnes fragiles dans une dépendance malsaine, selon le constat dressé par ses propres chercheurs un mois auparavant. Plusieurs affaires médiatiques, rapportées notamment par le New York Times, Ars Technica, Futurism ou l’agence Reuters, ont illustré la dangereuse spirale dans laquelle certains utilisateurs peuvent tomber, avec à la clé un décrochage parfois fatal avec la réalité. Alors le 7 août, OpenAI saute le pas, annonçant une nouvelle version de son robot, GPT-5. Son ton est résolument plus froid, et il surveille désormais la durée des conversations pour suggérer des pauses quand il le juge nécessaire. Lire aussi | Article réservé à nos abonnés ChatGPT : les débuts difficiles de GPT-5, le nouveau modèle de langage d’OpenAI, jugé moins efficace et moins « amical » L’entreprise applique ainsi deux recommandations-clés issues de chercheurs en IA parmi les plus critiques, dont des experts de Google, auteurs en 2024 d’une longue recension des dangers de l’IA. Dans ce document, ceux-ci anticipent un monde où la flatterie des robots réduit « les occasions qu’ont les humains de grandir et de se développerdevenir de meilleures versions d’eux-mêmes ». Voire « un monde où les utilisateurs abandonnent les interactions compliquées et imparfaitesavec les humains en faveur des échanges sans frictions fournis par les IA ». Il vous reste 73.15% de cet article à lire. La suite est réservée aux abonnés.

#meta #chatgpt #jeu #dangereux #dune

De Meta AI à ChatGPT, le jeu dangereux d’une personnalisation toujours plus poussée des IA

SOLÈNE REVENEY / « LE MONDE » C’est un paradoxe dans lequel bien des éditeurs d’intelligences artificiellessont empêtrés : pourquoi investir tant d’argent et d’efforts dans la création d’IA plus sûres et plus neutres si, une fois commercialisés, ces robots conversationnels peuvent être largement dévoyés ? Prenons le cas d’OpenAI. En avril, l’éditeur de ChatGPT dit réfléchir publiquement à rendre son robot conversationnel moins obséquieux, car il risque d’engager des personnes fragiles dans une dépendance malsaine, selon le constat dressé par ses propres chercheurs un mois auparavant. Plusieurs affaires médiatiques, rapportées notamment par le New York Times, Ars Technica, Futurism ou l’agence Reuters, ont illustré la dangereuse spirale dans laquelle certains utilisateurs peuvent tomber, avec à la clé un décrochage parfois fatal avec la réalité. Alors le 7 août, OpenAI saute le pas, annonçant une nouvelle version de son robot, GPT-5. Son ton est résolument plus froid, et il surveille désormais la durée des conversations pour suggérer des pauses quand il le juge nécessaire. Lire aussi | Article réservé à nos abonnés ChatGPT : les débuts difficiles de GPT-5, le nouveau modèle de langage d’OpenAI, jugé moins efficace et moins « amical » L’entreprise applique ainsi deux recommandations-clés issues de chercheurs en IA parmi les plus critiques, dont des experts de Google, auteurs en 2024 d’une longue recension des dangers de l’IA. Dans ce document, ceux-ci anticipent un monde où la flatterie des robots réduit « les occasions qu’ont les humains de grandir et de se développerdevenir de meilleures versions d’eux-mêmes ». Voire « un monde où les utilisateurs abandonnent les interactions compliquées et imparfaitesavec les humains en faveur des échanges sans frictions fournis par les IA ». Il vous reste 73.15% de cet article à lire. La suite est réservée aux abonnés.

#meta #chatgpt #jeu #dangereux #dune